Joachim Heintz

Vom Aufheben der Schildkröte zum Schreiben von Code

Keynote auf der 5. Internationalen Csound Konferenz in Cagli

Ich möchte über zwei Aspekte der Entstehung von Musik auf unserem Gebiet der Computermusik sprechen. Der erste Aspekt betrifft das Verhältnis von Hören und Hervorbringen. Ich werde ein Spiel spielen, in dem ich Komponieren als unmittelbare Fortsetzung des Hörens ansehe. Der zweite Aspekt betrifft das Verhältnis dessen, was wir als Komponisten hervorbringen wollen, zu dem Schreiben von Code in Csound. Ich möchte beobachten, ob das Programmieren eine Tätigkeit ist, die sich mit dem musikalischen Denken verbindet, oder ob es etwas der Musik ganz Fremdes ist — etwas rein Technologisches vielleicht, das man mit zusammengebissenen Zähnen akzeptieren muss, um die Klänge hören zu können, die man zu hören wünscht.

Es geht hier also um Hören, um Hervorbringen, um Code, um Musik. Aber was ist Musik? Eine Geschichte aus dem alten Griechenland, die ich vor langer Zeit einmal in Jacques Handschins Musikgeschichte gelesen habe, ist im Moment meine liebste Antwort auf diese Frage. Die Geschichte will den Ursprung der Musik aufzeigen, und sie erzählt, in meiner Formulierung, folgendes. Einst ging jemand seinen Weg und stolperte. In diesem Moment erhob sich ein Klang. Die Person hielt an und schaute zu Boden. Eine tote Schildkröte lag dort. Der Körper war schon verwest, aber außer dem Panzer gab es einige Sehnen, die noch intakt waren. Er, oder sie, nahm den toten Körper in den Arm, und zupfte die Sehnen. Das war die Geburt der Kithara, der griechischen Harfe, und so der Musik.

Ich glaube, die Geschichte hat Recht, wenn sie behauptet, den Ursprung der Musik zu erzählen. Schauen wir auf das, was geschieht. Zunächst ist da ein Unfall. Etwas liegt im Weg, und wir stolpern darüber. Das ist nichts Besonderes. Auch dass es ein Geräusch gibt beim Stolpern, ist nichts Besonderes. Was hätten wir getan? Ich hätte vielleicht geflucht und meinen Weg fortgesetzt. Dann wäre keine Musik entstanden. Aber dieser mythische Mensch kann sich wundern, er kann sich überraschen lassen, er kann das Besondere wahrnehmen. Er kann hören, in einem emphatischen Sinn. Bisher gab es keine Musik, aber nun, durch den so gestimmten Sinn dieser Person, durch diesen Geist, entsteht Musik. Sie entsteht genau in diesem Hören. Dieser Mensch ist für diesen Moment des Klanges ganz Hören. Und weil er so vollkommen erfüllt ist vom Hören, deshalb bleibt er stehen. Unwillkürlich. Ohne darüber nachzudenken. Das Hören hat gleichsam die Kontrolle übernommen, und es führt zunächst zum Anhalten. Man kann nicht einfach weitergehen, wenn man so hört. Man muss stehenbleiben. Der gewöhnliche Weg ist unterbrochen. Musik ist entstanden, genau in diesem Moment des Hörens. Und das ist, bei diesem Hören, immer und zwangsläufig neue Musik. Das was hier in diesem Moment zum Erstaunen, zum Aufmerken führt, ist das Neue, Ungewohnte, Besondere. Zehn andere hätten dasselbe gehört, aber für sie wäre es nichts Besonderes gewesen. Nicht neu, sondern eines von zahlreichen belanglosen Geräuschen der Umwelt. Die Geschichte beschreibt nicht nur den Ursprung der Musik, sie beschreibt auch den Ursprung der Neuen Musik. Und nun kommt der entscheidende letzte Aspekt. Der mythische Mensch geht nämlich nicht einfach weiter, nachdem er sich gewundert hat über diesen besonderen Klang. Er genießt oder betrachtet diesen Klang nicht nur. Sondern er beugt sich zu Boden. Er ergreift den Körper, der den Klang erzeugt hat, und nimmt ihn zu sich. Verweilen wir auch dabei noch etwas. Das Beugen, sich Verbeugen kennen wir von der Begrüßung, oder in religiösen Zeremonien. Es bedeutet: Ich erhebe mich nicht über dich, ich gebe meine Macht auf, ich lasse geschehen. Das emphatische, zur Produktivität führende Hören geht einher mit dieser Art von Selbstaufgabe. Es ist Tätigkeit durch das Geschehenlassen. Es ist Erzeugen durch Folgen, nicht durch Eroberung.

Durch das Verbeugen, durch die Berührung dieses toten Körpers der Schildkröte, wird auch die Erde berührt. Die Erde, von der wir kommen und zu der wir wieder gehen. Der mythische Mensch verbindet sich in dem Moment, wo er die auf der Erde liegende Schildkröte berührt, mit dem, was in vielen Sprachen Mutter genannt wird. Wir verbinden uns mit dieser Mutter, indem wir dem Hören folgen und den toten, aber klingenden Körper zu uns nehmen, aufheben. In diesem Aufheben findet eine Verwandlung statt. Zunächst ist es, als hebe der mythische Mensch ein Kind auf, um es in den Arm zu nehmen. Ist der klingende Körper erst einmal aufgehoben, wird er zur Erweiterung des eigenen Körpers, und gleichzeitig zu einer Art Werkzeug. Instrumentum, das Gerät, aber kein Gerät, um irgendetwas hacken oder schaben zu können, sondern ein Gerät für sich selbst. Ein Körper, der klingen soll, und da er die Erweiterung des eigenen Körpers ist, klingt auch der eigene Körper nun.

Das Hören hat zum Tun geführt; das Hören hat eine Aktivität ausgelöst. Und diese Aktivität, das Zupfen des mythischen Menschen an den Sehnen der toten Schildkröte, führt wiederum zum neuen Hören. Aha, der Klang ist verschieden, wenn hier oder dort gezupft wird. Tonhöhen entstehen und wollen begriffen werden. Die Geschichte sagt, dass so die Kithara geboren wurde — also beginnt der mythische Mensch, wenn er zuhause ist, etwas zu bauen, aus einem anderen Material, was diesen Klang reproduziert und ausbaut. Aus dem Hören entsteht der Bau von Instrumenten.

Beim Programmieren sprechen wir von einem Read-Eval-Print Loop (REPL). Im Mythos vom Urspung der Musik finden wir den Anfang einer anderen Kreis- oder Spiralbewegung. Wir hören etwas. Wir versuchen herauszufinden, was der Klang erfordert, was der Klang will. Und dann arbeiten wir es aus, und die Schleife beginnt von neuem: Wir hören das, was ausgearbeitet wurde; wir finden heraus, was zu tun ist; wir realisieren es wiederum, und so fort.

Die Geschichte beschreibt den Ursprung der Musik. Nicht den Beginn der Musik vor vielen tausend Jahren, sondern den Beginn der Musik immer wieder, auch heute, auch jetzt, potentiell auch jetzt. Und das ist das Spiel, das ich jetzt spielen möchte: Ob diese Technik, die keine Technik ist, sich auch auf elektronische Klänge anwenden lässt. Auf den fundamentalsten Klang, den wir in der Elektronik haben: einen farblosen Sinuston. Ich werde einen Sinuston von zwei Sekunden spielen, mit der Tonhöhe d’ und der Intensität -12 dB. Und wir hören diesem Klang zu und versuchen herauszufinden, was der Klang will; was der Klang von uns verlangt oder erbittet; was er uns, so wie wir eben hören, nahelegt.

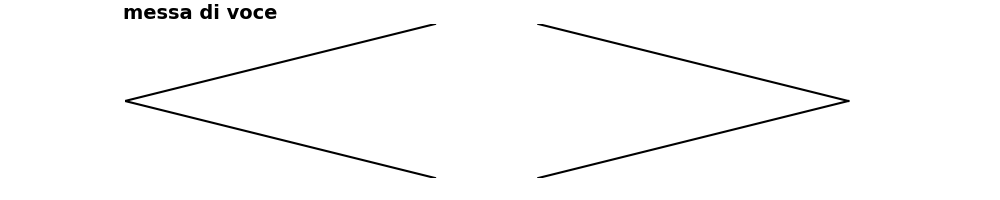

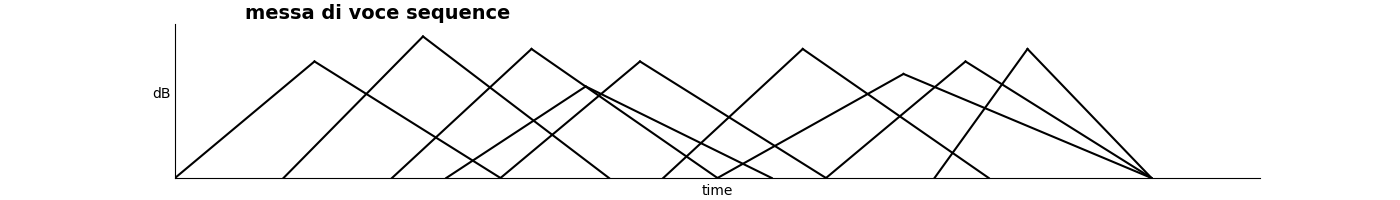

In meiner Wahrnehmung ist der Klang nicht glücklich mit der Art, wie er in die Welt kommt, und der Art, wie er aus der Welt geht. Der Klang will eine Hüllkurve. Eine? Oder mehrere? Zwei? Drei? — Ich habe das Gefühl: zwei. Und ich höre zwei unterschiedliche Charaktere. Der eine ist ein An- und Abschwellen, wie das alte messa di voce:

Oder etwas technischer: ein linearer An- und Abstieg im Sinne der Dezibel-Skala in der Zeit:

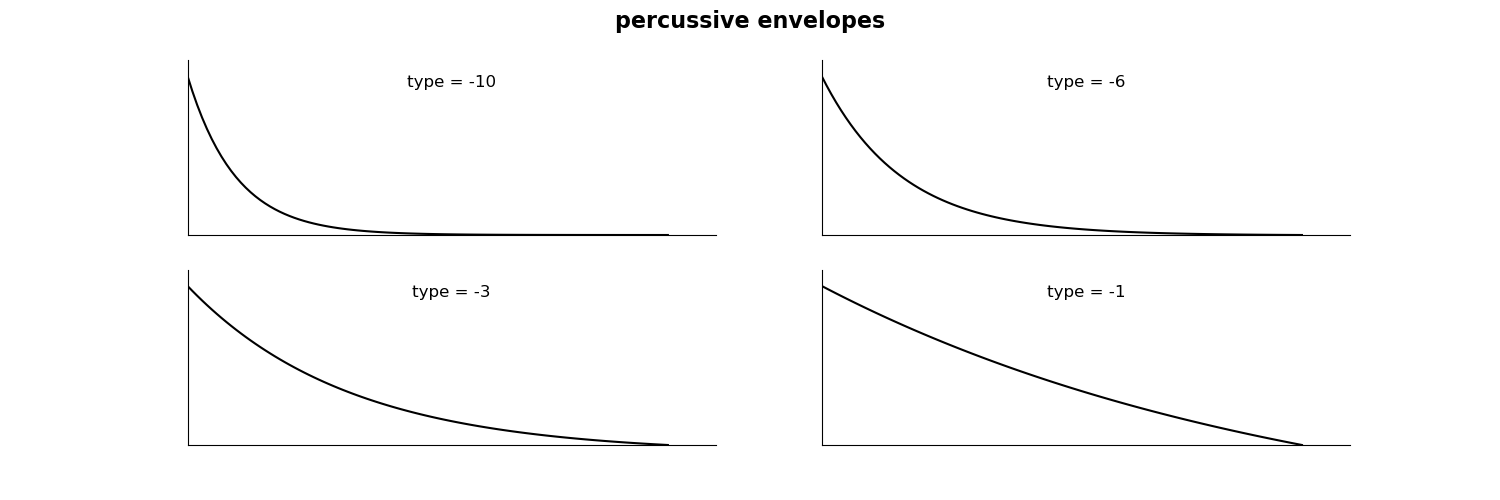

Die zweite Hüllkurve , der zweite Charakter ist perkussiv, ein wenig wie das Zupfen der Kithara:

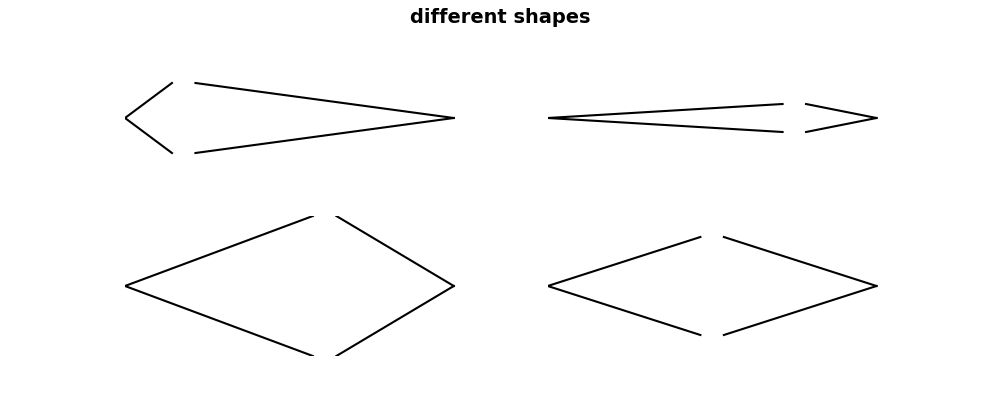

Nun haben wir zwei recht unterschiedliche Typen, und es ist wichtig, an Unterschiede und Abweichungen innerhalb dieser Typen zu denken. Als Vergleich: Hunde und Katzen sind verschieden, aber wie verschieden ist auch ein Hund vom anderen, und eine Katze von der anderen! Nehmen wir das messa di voce — dies sind einige mögliche Varianten:

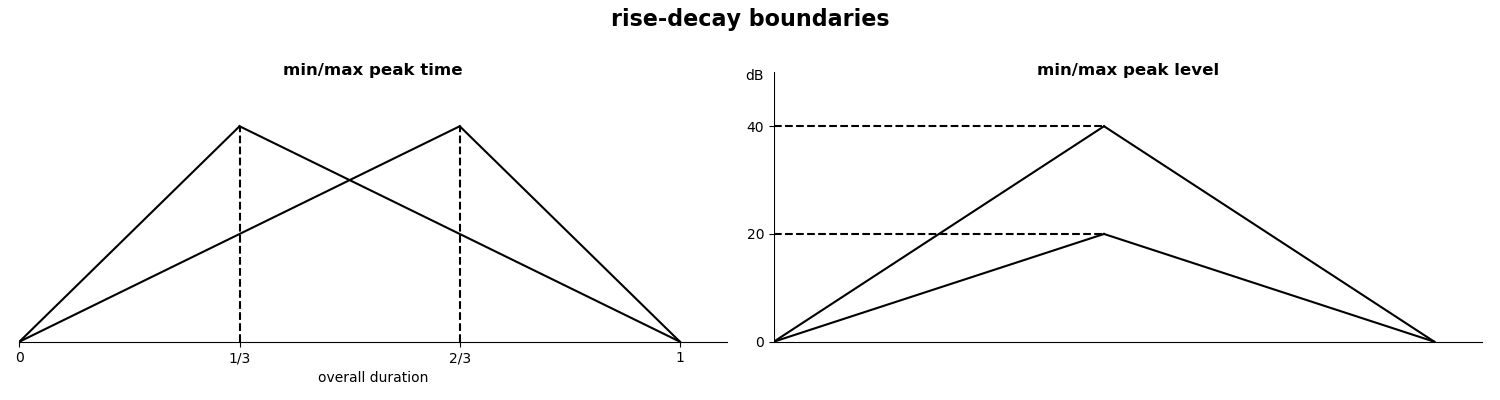

Analysieren wir diese Varianten, finden wir zwei Parameter, mit denen wir die Formen beschreiben können. Zum einen ist die Frage, wo bezogen auf die Gesamtdauer der Höhepunkt liegt: eher am Anfang, eher am Ende, eher in der Mitte. Zum anderen gibt es verschieden große Unterschiede der Lautstärke zwischen dem Höhepunkt und dem Anfangs- bzw. Endpunkt. Wir können nun die Abweichungen so realisieren, dass wir einen Bereich festlegen, innerhalb dessen wir Zufallsoperationen bestimmen lassen, welche Variante gewählt wird. Als Beispiel könnten wir festlegen, dass der Höhepunkt zwischen 1/3 und 2/3 der Dauer liegt, und der Unterschied von leisestem zu lautestem Punkt zwischen 20 und 40 dB betragen kann:

Hören wir uns vier Erscheinungsformen an:

Der perkussive Ton hat, neben Dauer, Tonhöhe und Lautstärke, nur einen Parameter: die Krümmung der Kurve:

Ich benutze hier schon den type Parameter, der im transeg Opcode in Csound auftritt. Es ist mit Hilfe dieses Opcodes sehr einfach, die verschiedenen Formungen mit Hilfe einer Zufallsauswahl in einem gewählten Bereich zu realisieren. Ich schreibe das, und dann hören wir wiederum vier zufällige Varianten, alle mit derselben Lautstärke und derselben Dauer:

Hat die Dauer auch ein mögliches Minimum und Maximum? Ja, und das Interessante ist, dass die Minima und Maxima bei beiden Charakteren einigermaßen verschieden sind. Das messa di voce kann sehr lang sein (zehn Sekunden), oder etwa drei Sekunden lang. Eine Sekunde ist ungefähr das Minimum dessen, was noch als messa di voce erscheint. Das ist ganz anders beim perkussiven Ton. Er kann nicht nur eine Sekunde kurz sein, sondern auch eine Zehntel oder sogar eine Hundertstel Sekunde. Es verändert sich dann zwar die Klangfarbe, das heisst, der Ton wird geräuschhaft, aber er ist immer noch ‘er selbst’ als perkussiver Toncharakter.

messa di voce 10 sec, 3 sec, 1 sec, 1/10 sec; perkussiv 3 sec, 1 sec, 1/10 sec, 1/100 sec

Hören wir diesen einfachen Tönen also wirklich zu, erhalten sie einen spezifischen Parameterbereich. Das wird noch deutlicher, wenn wir nicht nur über Einzeltöne, sondern über Gruppen von Tönen sprechen. Beim perkussiven Ton geht es dabei vor allem um Fragen des Rhythmus. Ich spiele zweimal eine Folge von perkussiven Tönen verschiedener Dauer und Lautstärke über zehn Sekunden; das erste mal mit einer ametrischen Folge, das zweite mal in einem einigermaßen erkennbaren Metrum.

Es öffnet sich also hier eine neue Dimension: welcher Rhythmus, welche Dichte, gibt es einen Prozess, und ähnliche Fragen mehr, die uns das Material nahelegt. Beim messa di voce Ton komme ich in eine andere Dimension, oder um im Spiel zu bleiben: der Ton möchte etwas anderes. Er möchte sich nämlich in der Dimension der Tonhöhe bewegen. Ich spiele wiederum eine Sequenz von zehn Sekunden; das erste Mal mit einem identischen Ton, das zweite Mal mit verschiedenen, meist sehr kleinen Tonhöhenabweichungen.

Dieses Material möchte, so finde ich, verschiedene Tonhöhen haben, und wir müssen herausfinden, welche das sein können bzw. wollen. Bewegen wir uns in einer chromatischen Skala, oder einer diatonischen, oder in einer Vierteltonskala, oder in einer durch ganzzahlige Verhältnisse gebildeten eigenen Skala? Und wie ist die Richtung, geht es auf- oder abwärts, oder pendeln, wie in meinem Beispiel, die Töne um einen Zentralton? Oder gehen wir weniger von der horizontalen Folge aus, sondern vielmehr von den gleichzeitig erklingenden Tönen, gestalten also die Intervalls bzw. Akkorde?

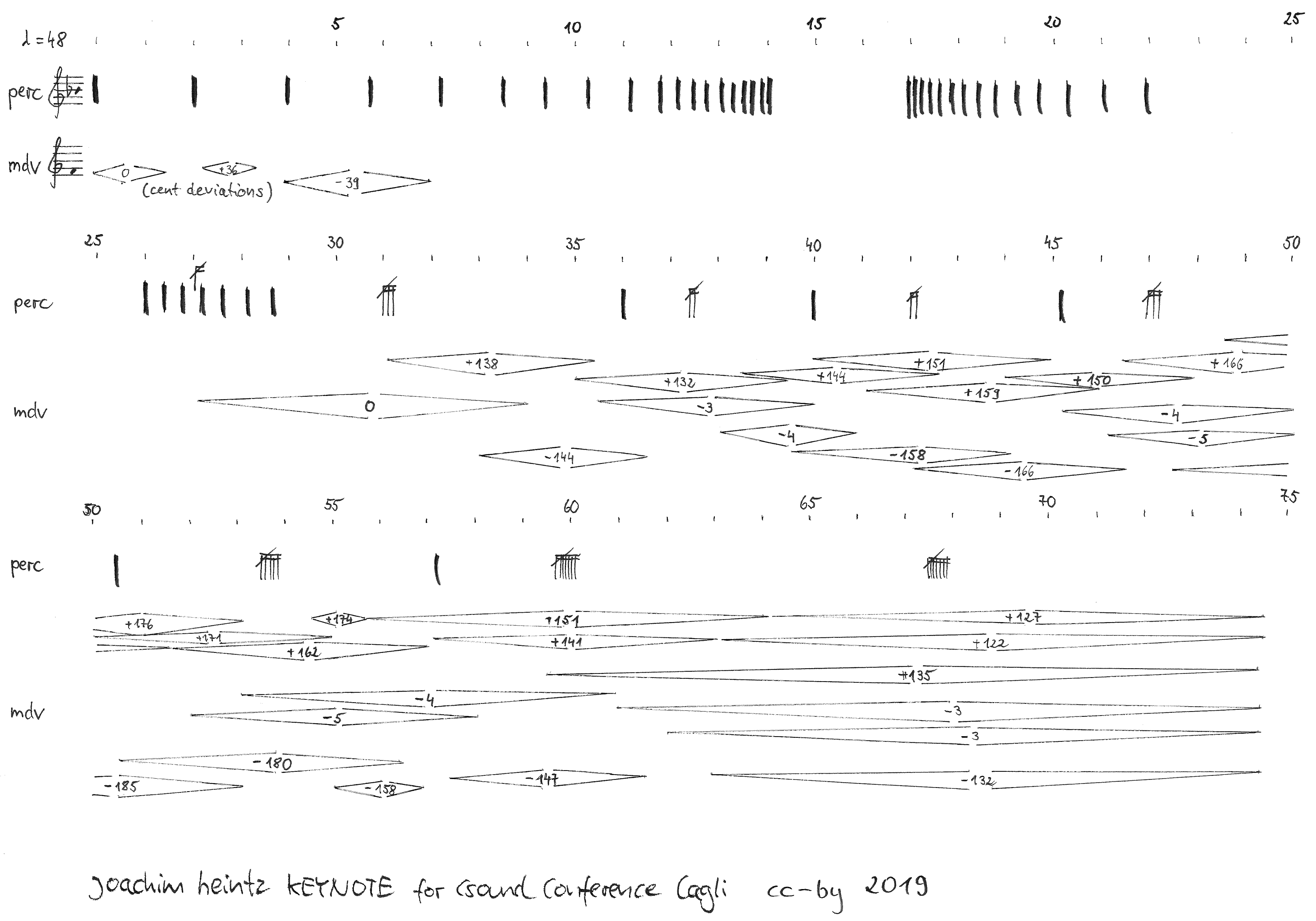

Ich finde es bemerkenswert, und in mancher Hinsicht geradezu überwältigend, welche Fülle an Möglichkeiten ein Material offenbart, wenn wir ihm zuhören, wenn wir ihm folgen. Und es sind spezifische Parameter und Dimensionen, die sich bei jedem Material anders öffnen — selbst bei einem so einfachen Material wie wir es hier vor uns haben: zwei einfache Hüllkurven eines Sinustons. Bei der messa di voce Hüllkurve geht es um die zeitliche Relation des Höhepunkts und die dynamische Abweichung, und wenn eine Sequenz entsteht, öffnet sich die Dimension der Tonhöhen. Bei den perkussiven Tönen geht es vor allem um die Dauer, auch die Krümmung der Kurve, und wenn eine Sequenz entsteht, öffnet sich die Dimension der Rhythmen. So komplex schon bei solch einfachem Material. Wie viele Stücke kann man damit komponieren. Hier ist eins davon:

Blicken wir noch einmal auf die Frage nach dem Verhältnis von Komponieren und Programmieren. Ich glaube, wir haben gesehen, dass grundsätzlich das Verhältnis der beiden Tätigkeiten sehr eng miteinander verbunden sein kann. Wir haben im Code das, was wir musikalisch wollen, sehr direkt und detailliert umgesetzt. Wo es bei Csound im Moment noch Defizite gibt, ist nach meiner Erfahrung in der Kommunikation zwischen größeren Einheiten, also in Csound Sprache: Instrumenten. Der Aufruf von Instrumenten über Parameter-Felder ist zu abstrakt und es gibt einige lästige Beschränkungen. Es wäre wünschenswert, dass wir, wie in Python beispielsweise, ein Argument mit einem Schlüsselwort verbinden können. Dann könnten wir einen deutlich lesbareren Code schreiben. Ebenfalls fehlt die Möglichkeit, Arrays an ein Instrument zu schicken. Ich hoffe, ich konnte zeigen, dass wir Komponieren als unmittelbare Fortsetzung des Hörens verstehen können und sollten. Musik entsteht, wenn wir das, was immer da ist, als Neues, Besonderes, Aufregendes hören; wenn wir dem, was wir hören, nachgehen; wenn wir seinen Willen herausfinden und, so gut wir können, verwirklichen.